原文地址 zhuanlan.zhihu.com

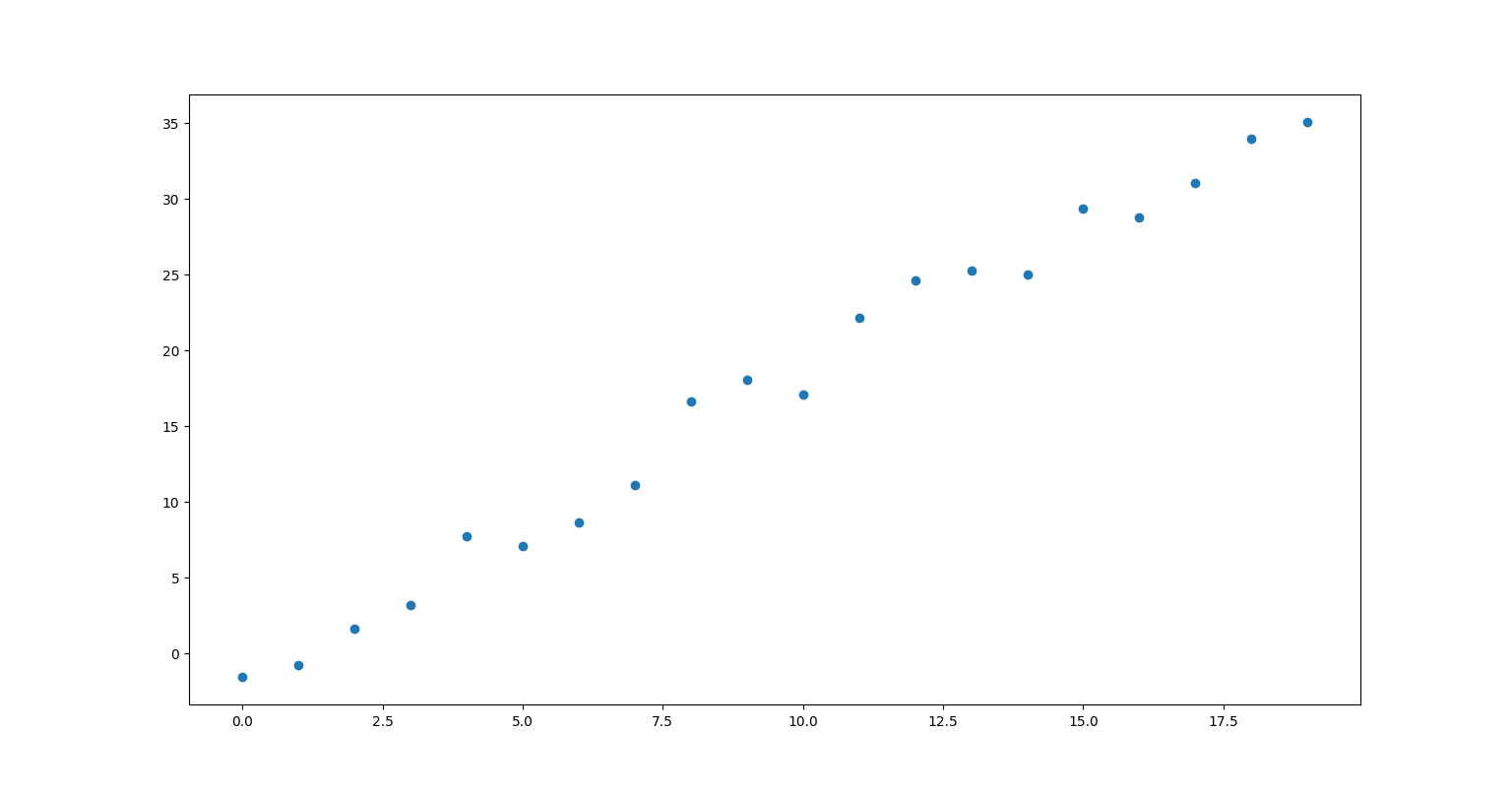

生成数据

- 生成线性相关的散点数据

1 | import numpy as np |

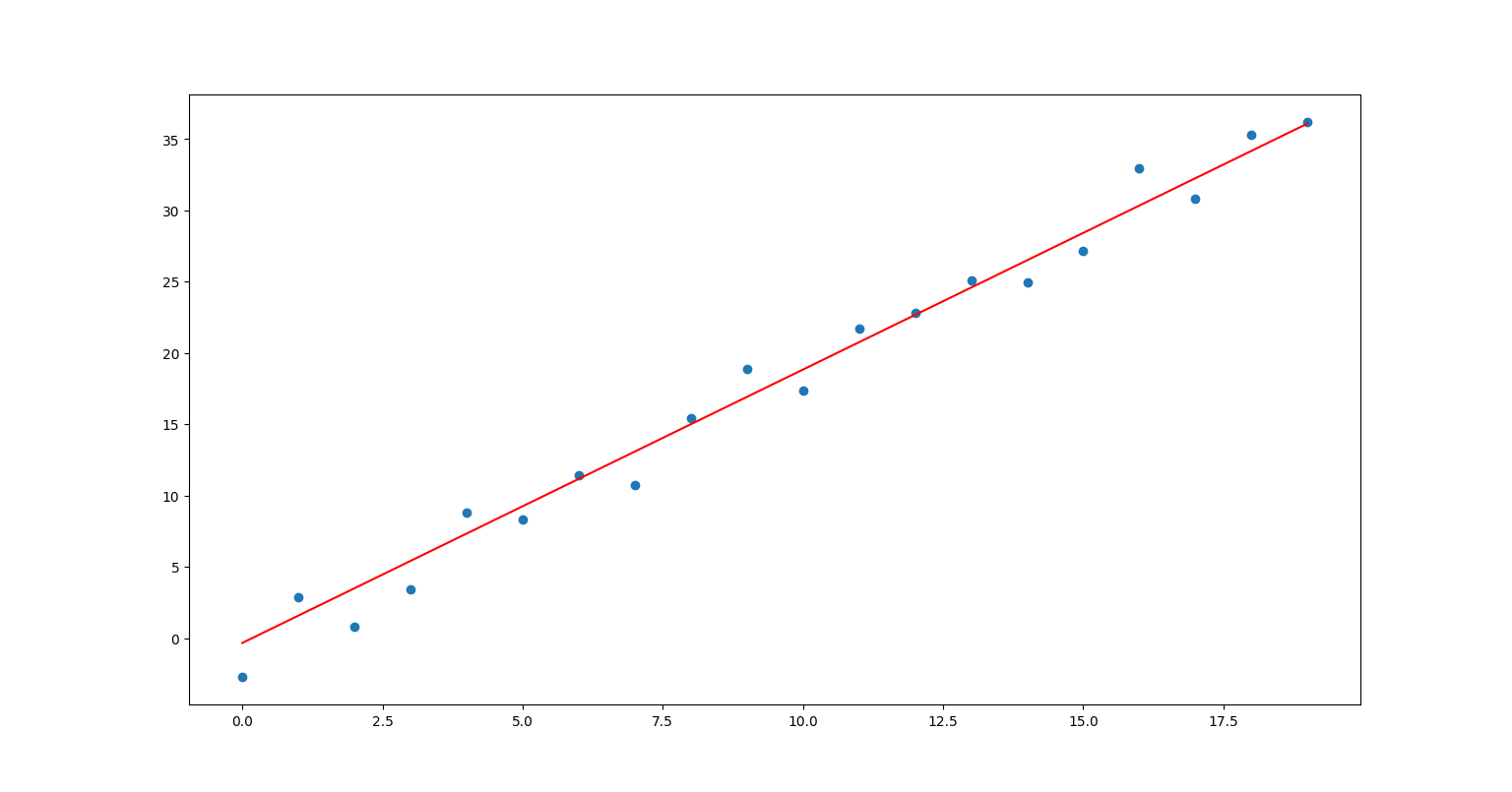

线性回归模型

$$

y = kx + b

$$

我们需要找到一个合适的参数k和b模型的预测值与真实值差异最小化。

预测值与真实值差异使用均方误差来体现:

$$

L(k,b) = \frac{1}{2n} \sum_{i=1}^{n} (\hat y_i - y_i)^2 = \frac{1}{2n} \sum_{i=1}^{n} (k x_i + b - y_i)^2

$$

其中$\hat y$是预测值,$y$是真实值。直观的来看,就是所有预测点到真实点的距离平均值的一半。这个式子我们也叫做损失函数。

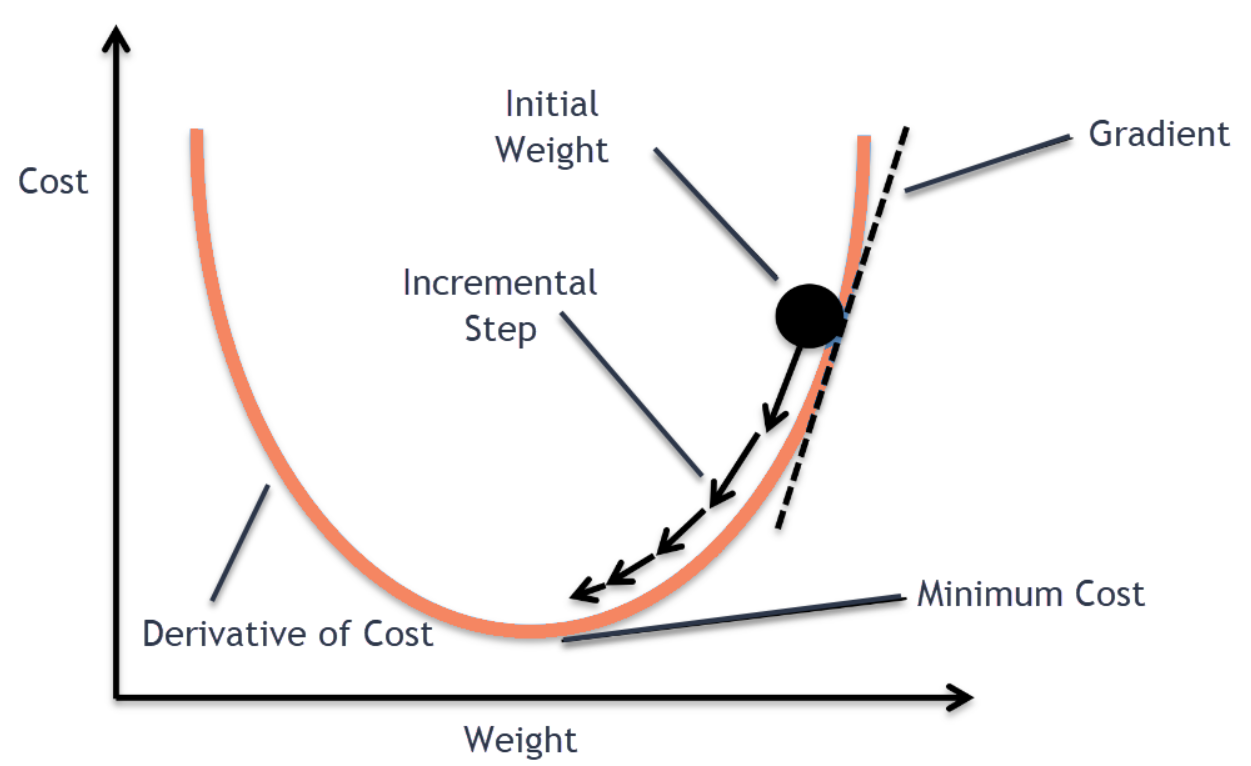

梯度下降法

为了得到总误差最小的线性模型,我们将使用梯度下降法。

梯度下降法的迭代关系式:

$$

\begin{align}

k_i &= k_{i-1} - \alpha \cdot \frac{\partial L}{\partial k_{i-1}} \

b_i &= b_{i-1} - \alpha \cdot \frac{\partial L}{\partial b_{i-1}}

\end{align}

$$

其中$\alpha$是步长,也称学习率。这里的$k_0,b_0$我们可以随机初始化一个数字。

通过微积分公式我们可以计算得知:

$$

\begin{align}

\frac{\partial L}{\partial k} &= \frac{1}{n} \sum_{i=1}^{n} (k x_i + b - y_i) \cdot x_i \

\frac{\partial L}{\partial b} &= \frac{1}{n} \sum_{i=1}^{n} (k x_i + b - y_i)

\end{align}

$$

算法实现

1 | # 模型函数 |

完整代码

1 | import numpy as np |